Big Data to ogromne i złożone zbiory informacji, których nie można analizować za pomocą tradycyjnych narzędzi. Ten termin opisuje nie tylko samą objętość danych, ale także zawrotną prędkość ich napływania i ogromną różnorodność formatów. Zrozumienie, co kryje się za tym pojęciem i jakie cechy definiują jego wartość, pozwala w praktyce podejmować trafniejsze decyzje biznesowe i odkrywać zupełnie nowe zjawiska rynkowe.

Spis treści

ToggleCo to jest Big Data? Definicja i historia pojęcia

Odpowiedź na pytanie, big data co to jest, kryje się w terminie opisującym ogromne zbiory danych, które ze względu na swoją objętość, szybkość napływania oraz różnorodność przekraczają możliwości przetwarzania tradycyjnych systemów i narzędzi analitycznych. Formalna definicja, rozwinięta przez firmę Gartner w 2012 roku, określa Big Data jako zasoby informacyjne wymagające innowacyjnych i efektywnych kosztowo form przetwarzania w celu uzyskania wartościowych wniosków. Początki tego pojęcia sięgają jednak 2001 roku i raportu analityków z META Group – instytucji przejętej później przez Gartnera – którzy jako pierwsi ujęli charakterystykę tych danych w tzw. modelu 3V.

W odróżnieniu od tradycyjnych, ustrukturyzowanych informacji, które można z łatwością analizować w systemach business intelligence czy arkuszach kalkulacyjnych, Big Data wyróżnia ogromna skala i złożoność. Dane te generowane są niemal w czasie rzeczywistym z wielu źródeł, takich jak media społecznościowe, czujniki urządzeń IoT, logi systemowe czy transakcje online. Kluczowym wyzwaniem nie jest samo gromadzenie informacji, lecz szybka i efektywna analiza, pozwalająca odkrywać wzorce i trendy niemożliwe do zidentyfikowania standardowymi metodami.

Model 5V, czyli 5 cech charakterystycznych Big Data

Koncepcja Big Data najczęściej opisywana jest za pomocą modelu 5V, definiującego pięć fundamentalnych atrybutów odróżniających te zbiory od tradycyjnych danych. Każda cecha wskazuje na konkretne wyzwanie oraz potencjał analityczny. Pierwotnie model obejmował trzy elementy (3V), ale został rozszerzony, aby precyzyjniej oddać złożoność zagadnienia. Te pięć filarów stanowi podstawę, by zrozumieć, co to jest Big Data w praktyce i jakie wyzwania się z nim wiążą.

Charakterystyka Big Data zgodnie z modelem 5V obejmuje:

- Volume (objętość) – Ogromna skala danych generowanych i gromadzonych, często liczonych w terabajtach, petabajtach, a nawet eksabajtach, przekracza możliwości przetwarzania standardowych systemów analitycznych.

- Velocity (prędkość) – Tempo napływania i przetwarzania danych, które często odbywa się w czasie rzeczywistym lub bliskim rzeczywistemu. Źródłami są m.in. dane strumieniowe z czujników IoT, transakcje finansowe czy aktywność na stronach internetowych.

- Variety (różnorodność) – Szerokie spektrum formatów: dane ustrukturyzowane (np. z baz danych), półustrukturyzowane (pliki XML, logi serwerów) oraz nieustrukturyzowane (teksty, e-maile, filmy, posty w mediach społecznościowych).

- Veracity (wiarygodność) – Znaczenie jakości i dokładności danych. W dużych zbiorach często występuje szum informacyjny, braki lub niespójności, co wymaga procesów weryfikacji i filtrowania w celu zapewnienia rzetelności analiz.

- Value (wartość) – Ostateczny cel przetwarzania Big Data – przekształcenie surowych danych w cenne informacje wspierające podejmowanie decyzji i generujące konkretne korzyści biznesowe.

Jak przebiega analiza Big Data? Etapy i technologie

Analiza Big Data to ustrukturyzowany, pięcioetapowy proces, który przekształca surowe dane w wartościowe wnioski. Jego realizacja wymaga specjalistycznych technologii, ponieważ tradycyjne narzędzia nie radzą sobie z tak dużą objętością, prędkością i różnorodnością danych. Każdy etap – od pozyskania danych po wizualizację – pełni kluczową rolę w wydobywaniu ukrytej wiedzy.

Proces przetwarzania danych dzieli się na następujące kroki:

- Zbieranie danych – Pozyskiwanie ustrukturyzowanych i nieustrukturyzowanych informacji z rozproszonych źródeł, takich jak systemy transakcyjne, media społecznościowe, czujniki IoT czy logi serwerowe.

- Przechowywanie – Magazynowanie ogromnych wolumenów danych w scentralizowanym repozytorium. Rozwiązania takie jak jeziora danych (data lakes) pozwalają przechowywać dane w surowym, natywnym formacie, w przeciwieństwie do tradycyjnych hurtowni danych.

- Przetwarzanie – Transformacja i przygotowanie danych do analizy. Przetwarzanie może mieć charakter wsadowy (duże bloki danych) lub strumieniowy (analiza danych napływających w czasie rzeczywistym).

- Analiza – Zastosowanie zaawansowanych technik, takich jak analizy statystyczne, algorytmy uczenia maszynowego i sztucznej inteligencji, by identyfikować wzorce, korelacje i anomalie.

- Wizualizacja – Prezentacja wyników w formie graficznej (interaktywne dashboardy, wykresy, mapy), ułatwiająca ich interpretację.

Do obsługi tych etapów wykorzystuje się dedykowane platformy technologiczne. Fundacją wielu systemów jest ekosystem Apache Hadoop z modelem MapReduce, który umożliwia rozproszone przetwarzanie danych. Popularne są też bazy NoSQL, dostosowane pod kątem elastyczności schematów, oraz narzędzia do analizy strumieniowej, niezbędne w projektach wymagających natychmiastowych reakcji.

Korzyści i praktyczne zastosowania Big Data w biznesie

Analiza Big Data pozwala firmom przekształcać ogromne zbiory informacji w wymierne korzyści biznesowe, głównie przez optymalizację procesów, wsparcie decyzji strategicznych i personalizację usług. Możliwość przetwarzania danych w czasie rzeczywistym otwiera przestrzeń do działań niedostępnych tradycyjnymi metodami analitycznymi.

Kluczowe korzyści i zastosowania to:

- Optymalizacja procesów w czasie rzeczywistym – Przetwarzanie strumieniowe danych, np. z sygnałów GPS, pozwala firmom logistycznym dynamicznie wytyczać trasy, unikając korków i redukując koszty oraz czas dostaw.

- Zaawansowana personalizacja usług – Analiza historii zakupów, aktywności online i interakcji z marką umożliwia tworzenie precyzyjnych ofert i rekomendacji, podnosząc zaangażowanie i lojalność klientów platform e-commerce i serwisów streamingowych.

- Wsparcie strategicznych decyzji – Analiza predykcyjna pozwala prognozować trendy rynkowe i zachowania konsumentów. Instytucje finansowe wykorzystują ją do wykrywania potencjalnych oszustw przez analizę transakcji.

- Odkrywanie nowych możliwości biznesowych – Przetwarzanie danych pochodzących z różnych źródeł ujawnia ukryte wzorce i korelacje, które prowadzą do innowacji w produktach i usługach.

Wyzwania, ryzyka i ograniczenia związane z Big Data

Mimo ogromnego potencjału, analiza Big Data niesie ze sobą istotne wyzwania, ryzyka i ograniczenia technologiczne. Złożoność przetwarzania dużych zbiorów danych oraz potrzeba inwestycji w specjalistyczne narzędzia czynią wdrożenia wymagającymi i kosztownymi. Problemy dotyczą zarówno jakości danych, jak i wydajności systemów.

Podstawowym ryzykiem jest niska wiarygodność informacji. Zbiory często zawierają dane niekompletne, sprzeczne lub błędne, co wymaga stosowania zaawansowanego czyszczenia i weryfikacji. Przetwarzanie bez właściwej filtracji może prowadzić do podejmowania decyzji na podstawie fałszywych korelacji. Wyniki analizy też muszą być krytycznie oceniane, by uniknąć kosztownych błędów.

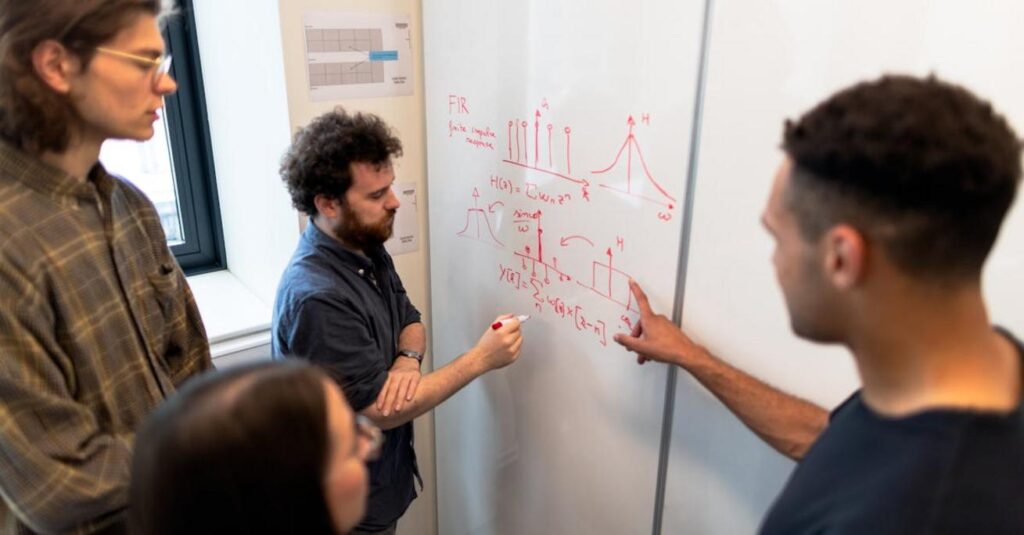

Główne ograniczenie stanowi niewystarczająca moc obliczeniowa tradycyjnych aplikacji i relacyjnych baz danych. Obsługa Big Data wymaga nowoczesnych rozwiązań – systemów rozproszonego przetwarzania, baz NoSQL oraz algorytmów sztucznej inteligencji i uczenia maszynowego. Wdrożenie tego zestawu wymaga zarówno sprzętu, jak i kadry wysoko wykwalifikowanych specjalistów, takich jak data scientists.

Trendy i najlepsze praktyki w analizie dużych danych

Obecnie analiza Big Data skupia się na dwóch głównych kierunkach: przetwarzaniu danych w czasie rzeczywistym oraz głębokiej integracji ze sztuczną inteligencją. Dynamiczny rozwój technologii zmienia narzędzia i podejście do zarządzania danymi. Organizacje coraz częściej odchodzą od wsadowego przetwarzania na rzecz analizy strumieniowej, a najlepsze praktyki zakładają elastyczne wykorzystanie zasobów chmurowych dla maksymalizacji wartości biznesowej.

Dominujące trendy i praktyki to:

- Analiza strumieniowa w czasie rzeczywistym – Przetwarzanie danych bezpośrednio po ich wygenerowaniu umożliwia błyskawiczne reagowanie na zdarzenia, np. w systemach rekomendacyjnych czy wykrywaniu fraudów.

- Integracja z AI i modelami językowymi – Wykorzystanie uczenia maszynowego do automatyzacji analizy oraz dużych modeli językowych (LLM) do przetwarzania i zrozumienia danych nieustrukturyzowanych, takich jak teksty.

- Przetwarzanie w chmurze – Standard branżowy zapewniający skalowalność, elastyczność i efektywność kosztową, umożliwiający dostęp do potężnej mocy obliczeniowej bez konieczności budowy własnej infrastruktury.

- Maksymalizacja wartości biznesowej – Skupienie się nie na samym gromadzeniu danych, lecz na ich praktycznym zastosowaniu i efektywnym przekładzie na wyniki.

Po wdrożeniu systemów analitycznych kluczowe jest stałe monitorowanie efektów, optymalizacja procesów oraz skalowanie infrastruktury w odpowiedzi na rosnące wolumeny danych. Takie działania zapewniają długoterminową efektywność i rentowność inwestycji.